Na nepravoslavni Božić, kraljica Elizabeta II je građanima Ujedinjenog Kraljevstva, i razjedinjenog sveta, nedavno bila uputila jednu sasvim netradicionalnu i krajnje bizarnu čestitku. Prvo se britanskom Kanalu 4 zahvalila na pozivu i mogućnosti da na televizoru konačno kaže ama baš sve što je tišti. Progovorila je i o nestašici WC-papira u pandemiji, pa i o svojim poteškoćama na toaletnom tronu. Kritikovala je i unuka Harija i snajku Megan, pošto bi ovi radije živeli sa mrskim Kanađanima. Da bi u 94. godini života najzad zavrckala zadnjicom i đuskala unaokolo kao tiktokerka. Ima na Jutjubu.

Na nepravoslavni Božić, kraljica Elizabeta II je građanima Ujedinjenog Kraljevstva, i razjedinjenog sveta, nedavno bila uputila jednu sasvim netradicionalnu i krajnje bizarnu čestitku. Prvo se britanskom Kanalu 4 zahvalila na pozivu i mogućnosti da na televizoru konačno kaže ama baš sve što je tišti. Progovorila je i o nestašici WC-papira u pandemiji, pa i o svojim poteškoćama na toaletnom tronu. Kritikovala je i unuka Harija i snajku Megan, pošto bi ovi radije živeli sa mrskim Kanađanima. Da bi u 94. godini života najzad zavrckala zadnjicom i đuskala unaokolo kao tiktokerka. Ima na Jutjubu.

Mnogo je manje verovatno da ćemo aktivirati svoje kritičko mišljenje i šatro medijske pismenosti kada nešto ugledamo, a ne pročitamo

Okej, u pitanju ipak nije bila ona stvarna kraljica Elizabeta Broj 2. Već tzv. deepfake ili „duboko lažni“ video, a koji je stvoren tehnologijom veštačke inteligencije. Čekajte, šta je sad to, stotinu mu neinteligentnih monarhija? Dotični dipfejkovi predstavljaju jedne izuzetno uverljive i veoma realistične video-uratke u kojima izvesna osoba naprosto izgovara stvari koje – nikada nije rekla. Zašto? Pa, zato što je savremena tehnologija tako u (ne)duhovitoj mogućnosti. Ove digitalne obmane verovatno su najnovija granica ili barikada u borbi sa lažnim vestima u društvu i javnosti. I upravo zato je ova (duboko) fejk Kraljica u svojoj satiričnoj božićnoj poslanici na Kanalu 4 i bila pozvala građane da ne veruju baš uvek svojim sopstvenim očima i ušima. I razborito je tvrdila kako je poverenje ona ključna reč savremenog doba.

Naime, poigravajući se novom digitalnom i pametnom tehnologijom, kreirani su mnogi zastrašujuće simpatični i simpatično zastrašujući klipovi u kojima npr. „učestvuju“ Princeza Leja ili Džim Keri (i to u Kjubrikovom Isijavanju umesto Džeka Nikolsona), ali i Barak Obama, Mark Zakerberg i Donald Tramp (kao Džoker ili onaj muljator iz Breaking Bad). Stvoreni su čak i klipovi koji u muzeju „oživljavaju“ jednog Salvadora Dalija, sve to putem inteligentnog učenja ili na osnovu tek 6.000 frejmova iz njegovih prethodnih intervjua za medije. Zadivljujuće čineći da Dali „komunicira“ sa publikom i na kraju ufotka selfi (jer naravno da Dali voli selfije). S tim u vezi, evo i zgodne liste desetak najboljih dipfejk video-radova koji se usput poigravaju sa našim mozgom i percepcijom mu.

Ova tehnologija se već uveliko koristi u holivudskim filmovima, a zasniva se na mašinama koje pametno uče. To jest, na naprednom učenju kako određeno lice tačno izgleda i ponaša se iz različitih uglova (po)smatranja. Istraživači sa Univerziteta Vašington iskoristili su softvere za veštačku inteligenciju da bi stvorili potpuno lažne, ali i vizuelno uverljive ili ekstremno realistične snimke Baraka Obame kako drži govor koji on nikada nije održao. Sve što im je trebalo jeste samo 17 časova Obaminih dotadašnjih obraćanja javnosti, time učinivši da mašina do najsitnijih detalja „zapamti“ njegove facijalne ekspresije i karakteristična mrdanja ustima. I, abrakadabra ili ćiribu-ćiriba, ovi podaci zatim se mogu (zlo)upotrebiti tako da Obami u usta doslovno turimo reči koje on nikada i nije izgovorio. Zvuči zastrašujuće? Možda zato što jeste.

Jer, pre nego što zatapšemo novim informacionim tehnologijama i njihovim preplaćenim programerima ili diveloperima, skapirajmo da se one zasnivaju na mašinama i na ljudima koji komotno kreiraju – laži. U pitanju naprosto jeste kvarna manipulacija slikom i zvukom. I koja je i kvalitativno i neuporedivo naprednija od famoznog „Fotošopa“ u kojem smo do sada (tehnologijom iz kamenog doba) samo peglali bore i podmlađivali lica, smanjivali strukove i uvećavali sise. A upotrebom ove najnovije tehnologije, anonimni glumac može da navuče masku, transformiše se u bilo koga, i da izgovori šta god poželi. Pametni softver će mu „nalepiti“ facu Obame, Trampa, Merkel, Bajdena i sličnih belosvetskih lidera, britanske kraljice ili Aleksandra Vučića, Pola Makartnija ili patrijarha Pavla, svejedno. Fotošop je bio stara dobra taština. Ali dipfejk je već distopijski i vrli novi svet.

Internet poznaje i tzv. Poov zakon, prema kojem će čak i parodija, satira ili ekstremni stavovi na internetu – imati sledbenike koji neće ukapirati fazon ili će lakoverno poverovati viđenom sadržaju

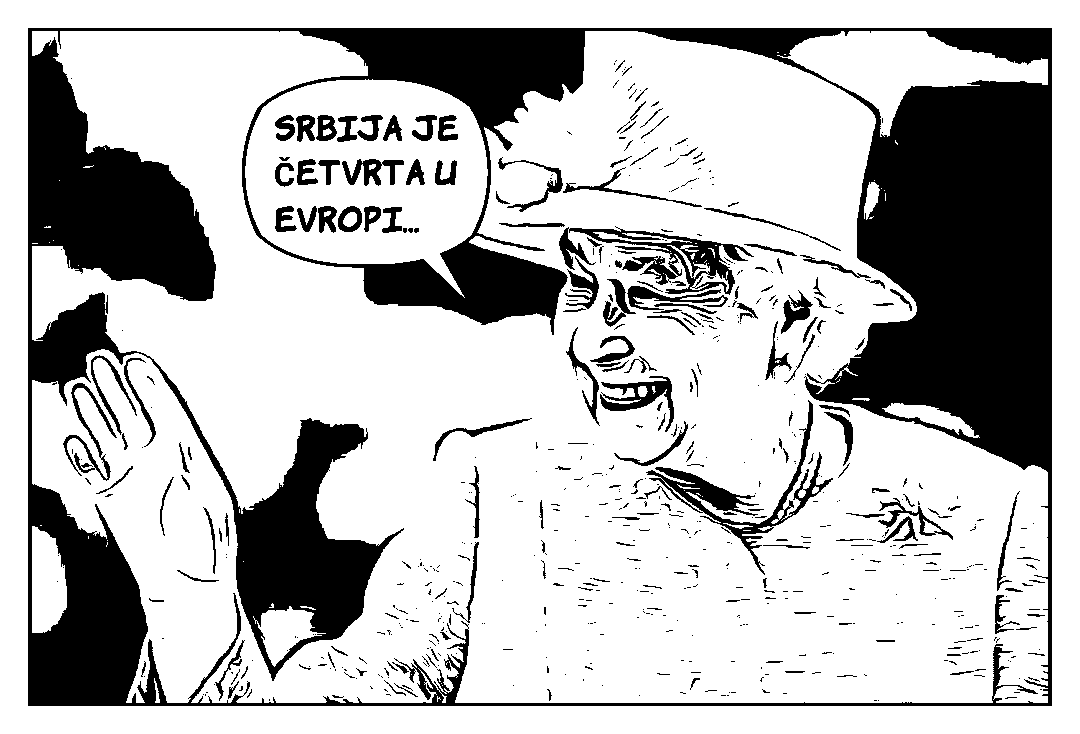

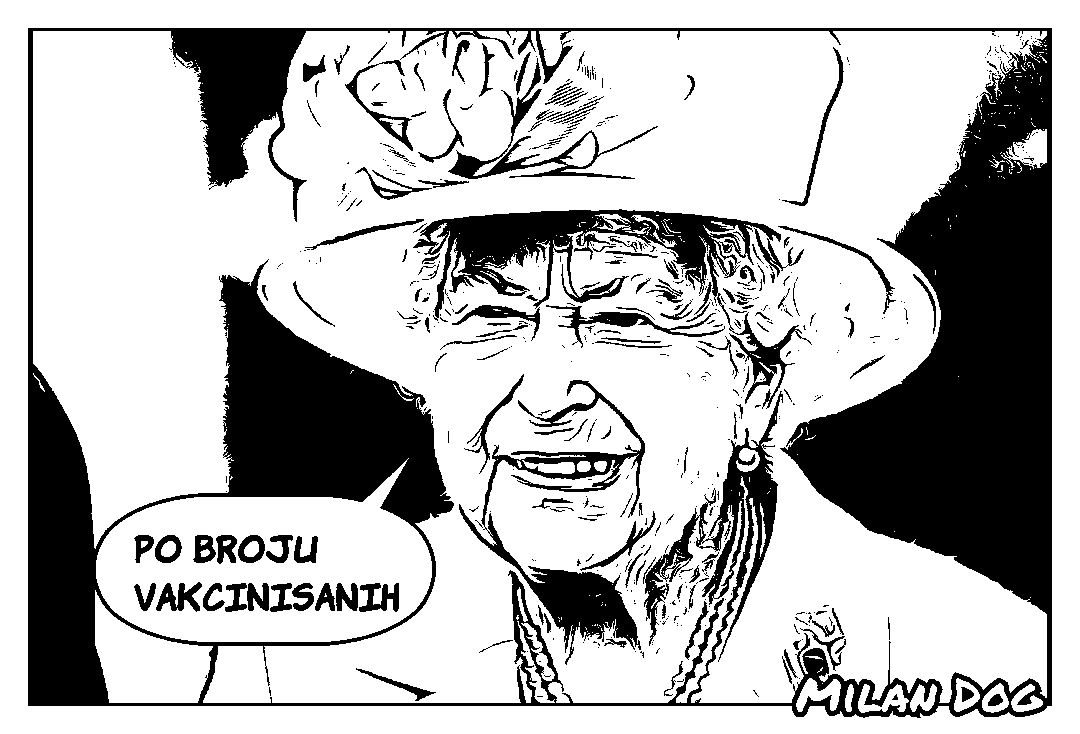

I tada nas neki globalni autoritet ili pak superzvezda mogu duboko lažno pozvati na kupovinu najnovijeg modela tojote, ajfona ili big meka. Baš kao i na nuklearni rat, ili na pogrom migranata, crnaca, gejeva ili Jevreja. Jer, internet poznaje i tzv. Poov zakon, prema kojem će čak i parodija, satira ili ekstremni stavovi na internetu – imati sledbenike koji neće ukapirati fazon ili će lakoverno poverovati viđenom sadržaju. Baš kao što ovu kraljičinu lažnu božićnu poruku nije skroz shvatilo oko dve stotine uvređenih Britanaca koji su, nakon svog čaja u pet posle podne, televiziji pisali gnevna pisma. Na internetima ili u Dobu sarkazma, jednostavno postaje sve teže razlikovati stvarnost i zajebanciju. I o čemu svedoči i učestalo mrtvo ozbiljno shvatanje pojedinih izmišljenih vesti sa satiričnih portala kao što je The Onion ili Njuz.net.

Izvesna zabrinutost političara, stručnjaka i javnosti danas jeste usredsređena na aktuelne tekstualne dezinformacije. To jest, na izvesni oprez, činjeničnu proveru ili kontrolu glede onoga što popularno nazivamo „lažnim vestima“ kao tekstova i informacija koje se pojavljuju po medijima ili internetima. Međutim, dobro je poznato da su slike ono što se najviše pamti, šeruje ili deli, zato što naš mozak slike obrađuje mnogo brže i efikasnije od teksta. Neuronaučnici sa MIT-ja utvrdili su da čitave slike možemo da skapiramo i usvojimo i nakon što smo ih videli u trajanju od samo 13 milisekundi. A što usput znači i da je mnogo manje verovatno da ćemo aktivirati svoje kritičko mišljenje i šatro medijske pismenosti kada nešto ugledamo, a ne pročitamo.

Na Cenzolovci smo već drobili o tome koliko je naš svet postao filtriran i uronjen u mehure, a što za posledicu ima jednu iskrivljenu percepciju stvarnosti. Ali možda najopasnija nuspojava celog tog mediološkog i kognitivnog procesa, kao i industrijske manufakture laži, jeste i sledeća činjenica. Ovo je samo početak. Ubrzo nas očekuju one Lažne vesti 2.0., a zatim i još novije i posve apdejtovane verzije istih. A nestrpljivi kakvi jesmo, možda i ne moramo da čekamo predugo? Na primer, na lažni ili dipfejk video „Dragog vođe“ Kim Džong Ila koji obznanjuje lansiranje nuklearnih raketa ka Sjedinjenim Državama, pa i na novog američkog predsednika koji je spor u zaključivanju – ali zato brz na atomskom obaraču.

Drugim rečima, dipfejk tehnologija danas ubrzano postaje dostupna i običnom Petru Petroviću sa uplatnice. I to u veoma jednostavnim aplikacijama poput (prikladno nazvane) FakeApp, kineske aplikacije Zao i mnogih njima sličnih drangulija. O čemu se tu radi? Zasad, o tome da prosto ufotkamo selfi, pa veštačko inteligentni program zalepi naše lice na glave i trupla glumaca iz popularnih filmova (poput Leonarda Dikaprija u Titaniku). Hm, Vorhol je izgleda bio u pravu: petnaest minuta slave za svakoga! I doživotna krađa ličnih podataka i personalnih facijalnih ekspresija usput.

Uzgred, zvuk ili audio danas je još lakše modifikovati od slike ili videa. Kompanija Adobe, poznata po spomenutom Fotošopu, još 2016. kreira program VoCo kao svojevrsni „Fotošop za zvuk“. A sličan mu je i program WaveNet i drugi. Dovoljno je pohraniti samo par minuta nečijeg govora u ove aplikacije, i zatim možemo diktirati bilo koje reči, koje će program izgovoriti tuđim glasom. Pa hajde onda, kopi-pejstujmo Musolinijeve tekstove na ekspoze sa inauguracija Bajdena ili Brnabić do mile i razonodne volje.

Pre nego što zatapšemo novim informacionim tehnologijama i njihovim preplaćenim programerima ili diveloperima, skapirajmo da se one zasnivaju na mašinama i na ljudima koji komotno kreiraju – laži

Najzad, ljudske životinje ne bi bile ljudske životinje da ovu tehnologiju izdašno ne koriste za – pornografiju. Dakle, za to da manipulišu pornićima upotrebom spomenutih dipfejk aplikacija. U tom erektivnom poduhvatu, menjaju se lica pornografskih glumica sa licima onih mejnstrim glumica, ili uopšte osoba koje priželjkujemo da vidimo u seksplicitnoj ili hardkor akciji. Zapravo, želja za penetrirajuće duboko lažnom pornografijom možda je i bila zakovitlala celu tu dipfejk tehnologiju na prvom mestu. Što ne treba da iznenađuje – upravo su rat, seks i brza hrana bili pokrenuli praktično sve tehnološke proboje u čitavom 20. veku.

Po mračnim sokacima interneta razotkriva se komotni transfer seksualne imaginacije pravo u virtuelnu realnost svetske mreže. Već postoje dipfejk pornografski klipovi ili duboko lažni pornići sa Natali Portman, Emom Votson, Kejt Midlton, Mišel Obamom itd., što preispituje granice ljudske pristojnosti, ali i briše razliku između stvarnosti, fikcije i fantazije. I paralelno ogoljuje i gomilu etičkih dilema. Jer, iako je u pitanju lažni video, da li na ovaj način ipak vređamo i povređujemo ove žene? Da li zaista nije važno ukoliko nije stvarno? I šta ćemo sa ništarijama koje ovako nastoje da se pornografski osvete bivšim devojkama i ženama? Sa toliko selfija po Fejsbuku i Instagramu, svačiji vizuelni identitet možemo ukrasti i zalepiti u pornografski film – naše koleginice sa posla ili faksa, naše simpatije ili pak one male sa trećeg sprata o kojoj potajno maštamo. Seks, laži i video-trake vaistinu.

S druge strane, Sem Gregori, programski direktor grupe WITNESS koja edukuje aktiviste oko upotrebe video-materijala, upozorio je da ne treba ni preterati sa pričom o pretnjama od svih tih sintetičkih ili veštački inteligentnih medijskih sadržaja na internetima. Za Gregorija, gužva oko hipotetičkih opasnosti od političkih dipfejkova, umnogome prikriva onu stvarnu i nekako staroškolsku opasnost od dezinformacija u društvu. Opasnosti od propagande, ali i od cenzure. Svakako se valja bolje pripremiti za ove duboke laži, prepoznati postojeće izazove, istraživati, koordinirati, povezivati se, zahtevati vrednosti inkluzije i ljudskih prava, te negovati nezavisnost i objektivnost, otprilike kao i do sad. Ili kao od pamtiveka.

Društvena kriza ili društveni problem lažnih vesti kojem živo svedočimo zaista može da bude samo početak. Onaj stvarni medijski i društveni izazov zato nisu samo fabrike botova i manufakture lažnih vesti po (eks-Titovom) Velesu i ostalim dvanaestopalačnim crevima worldwide weba. Već je to i ubrzana stopa „pametnih“ tehnoloških promena koje omogućuju da veštačka inteligencija tupavo proizvede sve i svašta nakaradno, zlo i naopako. A problem je i činjenica da naša zaostala kultura, iz gotovo paleolita, još uvek nije sasvim spremna da navedene promene prihvati i uopšte shvati podjednakom brzinom.

Još od dvadesetih godina prošlog veka sociolozi zato dobro prepoznaju i fenomen tzv. kulturnog zaostajanja za tekućom tehnologijom. Naše kulture, pa i naše vrednosti i norme, naprosto se menjaju mnogo sporije od naših tehnologija. Pa i naši (lažni) morali kasnili su za tehnologijama bikinija ili mini-suknje, zar ne? Možda je danas zabavno i nekako seksi zalepiti facu Džima Kerija u kultno Isijavanje, lice Natali Portman u podjednako kultno Duboko grlo (ili u one fejk kauč-audicije). I kikotati se zbog kraljice Elizabete II koja tiktokerski mrda kukovima za Božić. Ali šta ćemo raditi sutra? Mogućnost da tehnološki ubedljivo isfabrikujemo šta ljudi govore i rade u tim Lažnim vestima 2.0., naš plitki problem medijskih dezinformacija lansira u jednu sasvim novu i krajnje duboku simulaciju – ili u našu duboku stvarnost.

Ubistvo u Ulici Slavka Ćuruvije

Ubistvo u Ulici Slavka Ćuruvije Šta čeka medije u 2024: Ugovor sa đavolom ili otpor - pa šta bude?

Šta čeka medije u 2024: Ugovor sa đavolom ili otpor - pa šta bude? Kako u najezdi laži i gubitka poverenja u medije osnažiti informisanje u interesu građana i svest o značaju pouzdane vesti

Kako u najezdi laži i gubitka poverenja u medije osnažiti informisanje u interesu građana i svest o značaju pouzdane vesti

Ostavljanje komentara je privremeno obustavljeno iz tehničkih razloga. Hvala na razumevanju.